Un débat du Forum Cybersécurité IA.Cloud d’avril consacré au Green IT a mis en lumière la mutation des datacenters sous l’effet de l’intelligence artificielle, des puissances de calcul et des exigences de transparence environnementale.

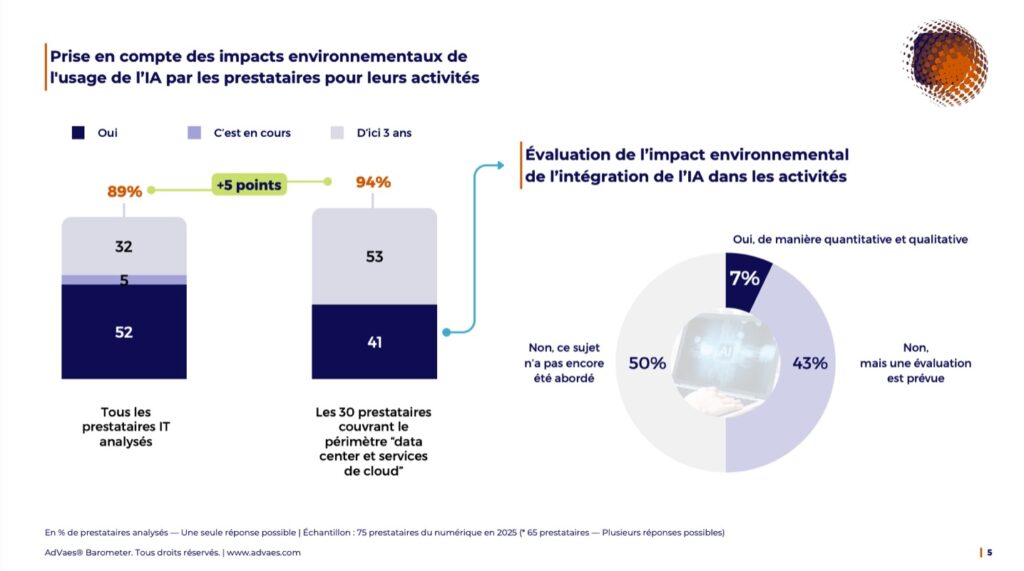

Hausse de la densité des racks, évolution des refroidisseurs, pression réglementaire : le datacenter cherche son nouveau souffle. Quelques chiffres récents partagés par Emmanuelle Olivié-Paul, présidente

d’Advaes, fournissent d’emblée le ton du débat.

L’évolution des consommations énergétiques et des impacts carbone du numérique signale une progression annuelle de 24% entre 2022 et 2024, avec une inflexion en 2023, l’année de la démocratisation des IA génératives, un cadeau temporaire en forme de mise en bouche des géants du cloud et de l’IA.

Mais les prestataires du cloud, des datacenters et des services numériques ne publient pas les mêmes indicateurs, faute d’entente sur les référentiels. Le bilan carbone insuffisant, est bousculé par le protocole GHG, couvrant les émissions de sept gaz à effet de serre. Ce protocole ne se concentre pas uniquement sur les résultats, mais comprend aussi une analyse approfondie visant à identifier les opportunités de réduction les plus efficaces. La demande de transparence progresse donc, portée par les enjeux de reporting extra-financier et par la volonté des clients de pouvoir comparer les offres d’hébergement de ressources.

Des usages variés de l’IA aux impacts profonds

Le point le plus sensible reste la diversité des usages de l’intelligence artificielle, très énergivores. Les intervenants soulignent le fait que ces usages transforment la conception même des infrastructures. Le datacenter n’est plus seulement un lieu d’hébergement, mais devient une usine numérique de plus en plus dense qui doit absorber des puissances d’énergie et de calcul incomparables avec celles d’hier.

Les objectifs des bâtisseurs de centres de données traduisent cette accélération. Tout en visant toujours la rentabilité au travers des usages de leurs infrastructures, ils doivent désormais réduire des pointes de consommation d’énergie, lisser des charges et optimiser leurs systèmes de refroidissement. Cette logique se précise lorsque les serveurs montent en puissance et que les exigences de continuité de service s’accentuent.

Le refroidisseur devient stratégique

Le classique refroidissement par air atteint ses limites dès que les puissances par rack dépassent 30 kW. Le liquid cooling s’impose alors comme une réponse salutaire, sous forme « de plaques froides accolées aux processeurs (CPU et GPU) ou par immersion de rack dans un bain diélectrique, non conducteur. On évite ainsi la surchauffe, et on peut récupérer la chaleur fatale pour la réinjecter dans un circuit de chauffage urbain, vers des serres agricoles ou des installations industrielles. Tout n’est pas négatif donc, » estime François Tournesac, le CEO d’Impleon. Sans chercher à nier l’impact du datacenter sur l’environnement, son argument signale une valorisation bienvenue du bâtiment énergivore.

Il signale un gain d’énergie pouvant atteindre 30% par datacenter. Or, on compte environ 350 centres opérés par des prestataires en France.

Un enjeu territorial

Sur l’Hexagone, les datacenters se concentrent autour de métropoles comme Paris et Marseille. Cette répartition s’explique par la qualité des réseaux, la présence de fibres optiques et l’accessibilité de l’énergie. Mais les intervenants soulignent que les futures installations devront être mieux réparties sur les territoires et plus proches des usages, notamment pour guider les futurs véhicules autonomes.

La question de la réutilisation de friches industrielles est évoquée comme une piste crédible. Cette reconversion réduit l’artificialisation des sols, limite les conflits d’usage et offre une seconde vie aux locaux déjà alimentés en réseaux et en énergie. Néanmoins, « il existe un plafond de verre pour décarboner les data centers, en particulier anciens, pour les rendre un peu plus vertueux d’un point de vue environnemental, » note David Remaud,

Consultant Numérique Responsable et fondateur de

Num&Res.

La transparence comme condition

Autre message fort du débat : sans données d’émissions nocives, de consommation de ressources naturelles et d’énergie, aucun pilotage sérieux n’est possible. Les opérateurs et les clients ont besoin d’indicateurs fiables pour choisir les solutions les moins impactantes, encore faut-il avoir accès à ces données. Le besoin de transparence concerne l’eau, les émissions indirectes et les conditions de fabrication des équipements exploités.

En effet, l’empreinte du numérique ne se limite pas au fonctionnement des serveurs. Une grande partie de l’impact se situe en amont, dès l’extraction des matières premières, la fabrication des composants et l’assemblage des équipements, réalisés hors d’Europe le plus souvent. Cela rend la lecture du sujet plus complexe, mais aussi plus urgente.

« Lorsqu’on analyse l’impact environnemental d’alternatives, on doit raisonner sur leur cycle de vie. Par exemple, pour un simple smartphone de 200 grammes, il faut extraire l’équivalent de 200 kg de matières premières et consacrer un millier de litres d’eau à sa fabrication, » rappelle David Remaud. La dynamique de réduction d’impacts devrait englober l’intégralité des ressources nécessaires ainsi que le volet sociétal du datacenter.

Une industrie en transition

Au fil des échanges, les intervenants désignent le datacenter comme un site industriel à part entière, et non plus comme un simple relais de serveurs informatiques. Sa maîtrise exige donc des compétences complémentaires, de l’ingénierie des refroidisseurs à la supervision unifiée (énergie, disponibilité des services, impacts environnementaux). Il doit s’inscrire désormais dans une logique de territoire, de conformité réglementaire et de sobriété.

Le datacenter dédié à l’IA doit anticiper cette transformation autour de ses propres infrastructures. Il ne se contente plus de servir de simples silos de stockage numérique, mais s’apprête à coordonner des agents interopérables, tout en réduisant sa consommation d’énergie. Dans cette perspective, il devient le pilier essentiel d’un développement numérique durable, voire souverain lorsqu’il est opéré en circuit court.