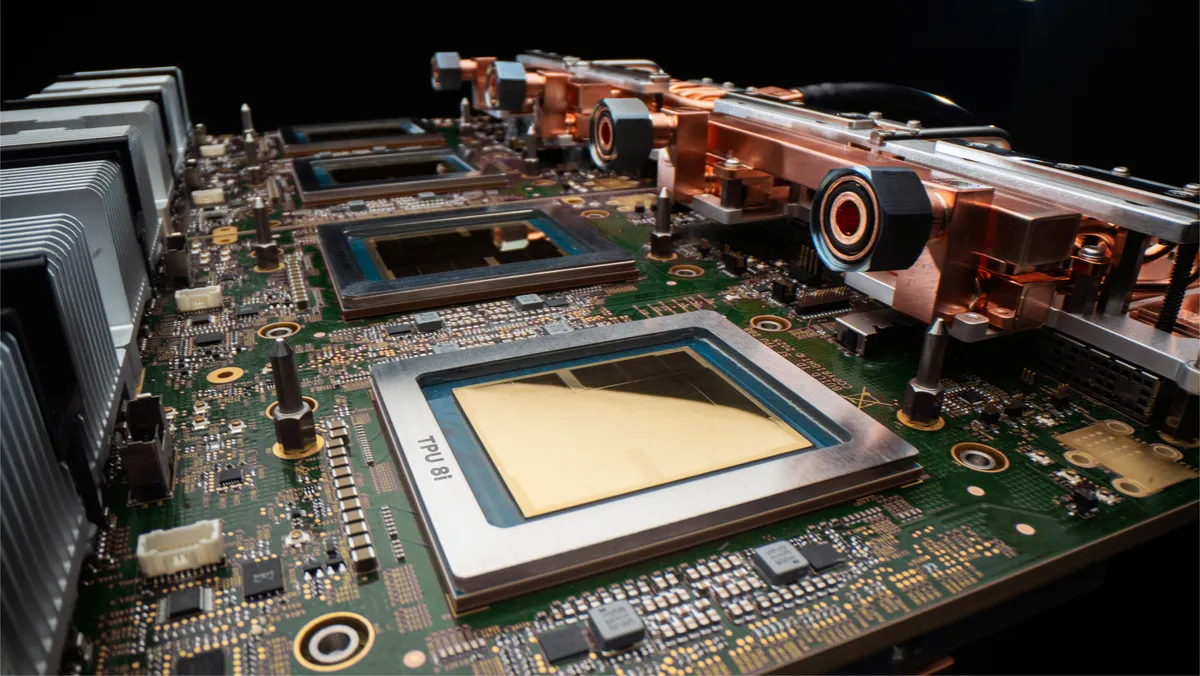

Google Cloud lance une nouvelle génération de Tensor Processing Unit (TPU) pour industrialiser les usages de l’IA agentique. Le TPU 8t cible l’entraînement des modèles linguistiques, tandis que le TPU 8i soutient l’inférence à faible latence.

En route vers les agents IA et assistants métiers exécutant des tâches complexes, en continu et sans délai. Moins d’un an après le lancement des pods Ironwood fondés sur ses TPU v7, Google ouvre la voie aux applications d’entreprises les plus exigeantes. Les pods pouvant concentrer plusieurs milliers d’accélérateurs, ils pourraient délivrer une capacité de calcul de 121 exaflops, contre 42 pour la génération précédente.

Les applications modernes doivent traiter davantage de contexte, enchaîner plusieurs étapes de raisonnement et interagir avec plusieurs flux de données internes. Elles abordent l’automatisation de processus, les simulations économiques et l’aide à la décision. Mais aussi la recherche documentaire, le brassage de savoir-faire et le soutien des clients.

Google met en avant des gains de performance, d’efficacité énergétique et de coûts, des critères décisifs pour faire passer l’IA en production. Son récent TPU 8t est conçu pour l’entraînement massif des modèles, tandis que le TPU 8i vise l’exécution au travers d’une architecture réduisant les temps de réponse.

Pour l’entreprise utilisatrice, la promesse consiste à disposer d’une infrastructure cloud, à base d’instances GCP ou d’AI Hypercomputer, supportant la conception et l’exécution d’agents IA autonomes, réactifs et enfin rentables. De quoi transformer des flux de travail et d’orchestrer des services numériques, conçus avec et pour l’IA.

A très grande échelle, la cartographie des connaissances d’entreprise pourra permettre la découverte fine de chaque sous-process et des données associées, afin d’orchestrer et compléter à la demande de futures chaînes de commandement multi-agents.